Zusammenstellung der Infrastruktur auf Azure Data Lake

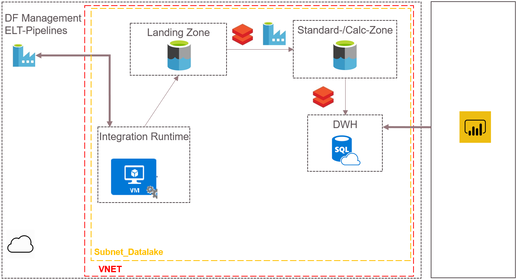

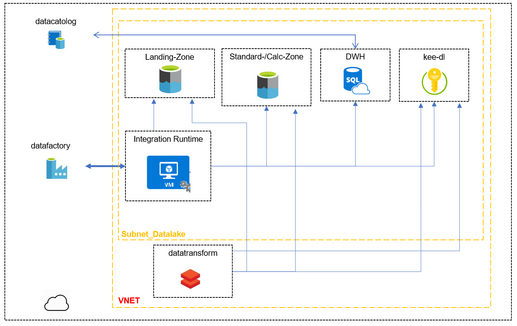

Die Abbildung 1 zeigt die komplette Infrastruktur mit Netzwerkzugehörigkeit und Netzwerkverbindung auf. Der Aufbau des Data Lakes ist für Enterprise Architekturen konzipiert, sodass on-premises Cluster eingebunden werden können. Es ist zu empfehlen, die Dienste in einem separaten Subnetz zu deployen, damit der Zugang zu einem Data Lake auch innerhalb einer Organisation regelbar ist.

Einige Dienste besitzen noch keine Netzwerkschnittstelle und müssen deshalb außerhalb eines VNET bereitgestellt werden; zurzeit betrifft das die Data Factory und den Data Catalog. Die Integration Runtime wird notwendig, wenn on-premises gehostete Quellsysteme mit der Cloud verbunden werden sollen. Je nach Netzwerkverbindung mit der Azure-Cloud muss diese auf einer VM im Subnetz oder auf dem Cluster on-premises installiert werden.

In unserem Konzept teilen wir den Data Lake Storage in zwei verschiedenen Ressourcen auf: die Landing-Zone und die Standardization-Calculation-Zone. Das soll die Auswirkung von Fehlern eingrenzen. Der Databricks-Cluster (dbstranform) befindet sich ebenfalls außerhalb des Subnetzes, da sich eine Integration in ein Subnetz derzeit nicht umsetzen lässt. Bei dem Data Warehouse handelt es sich um eine Light-Weight-Variante, in der nur aggregierte Daten vorgehalten werden, was zu einer Minimierung des Datenbankspeichers und somit zu einer Reduktion der Kosten führt. In dem Azure Data Vault (kee-dl) werden verschlüsselt User, Passwörter und Token vorgehalten, die für eine Authentifizierung gegenüber den Azure Diensten erforderlich sind.